<li id="rnldf"></li>

4月1日,在沉默了近一周后,谷歌引發(fā)爭議的壓縮算法TurboQuant論文團(tuán)隊終于回應(yīng)了。然而,這一最新的“技術(shù)澄清”看起來仍未平息爭議,針對“核心技術(shù)相似性”的指控,谷歌辯稱隨機(jī)旋轉(zhuǎn)是標(biāo)準(zhǔn)技術(shù),并認(rèn)為實驗基準(zhǔn)中的錯誤對事實“并不重要”。

在3月最后一周,這篇被谷歌官方博客高調(diào)宣傳的論文,曾以一己之力砸崩全球存儲芯片股,美光、SK海力士、三星電子等市值蒸發(fā)超900億美元。論文指出,TurboQuant 這種壓縮算法能夠?qū)⒋笳Z言模型的 KV 緩存內(nèi)存占用減少至少 6 倍,速度提升高達(dá) 8 倍,且精度零損失。

華爾街的恐慌在于:如果軟件能把AI內(nèi)存需求壓縮6倍,芯片硬件的增長邏輯就要重寫。

然而,反轉(zhuǎn)來得很快。3月27日,RaBitQ作者、蘇黎世聯(lián)邦理工學(xué)院博士后高健揚(yáng)在知乎發(fā)布萬字長文,指控谷歌團(tuán)隊存在系統(tǒng)性學(xué)術(shù)問題,輿論迅速轉(zhuǎn)向?qū)雀鑼W(xué)術(shù)不端的拷問。

業(yè)界普遍認(rèn)為,RaBitQ率先提出了原創(chuàng)方法,TurboQuant在其基礎(chǔ)上進(jìn)行了優(yōu)化,卻未給予應(yīng)有的引用與尊重,甚至作出了不公正的貶低。

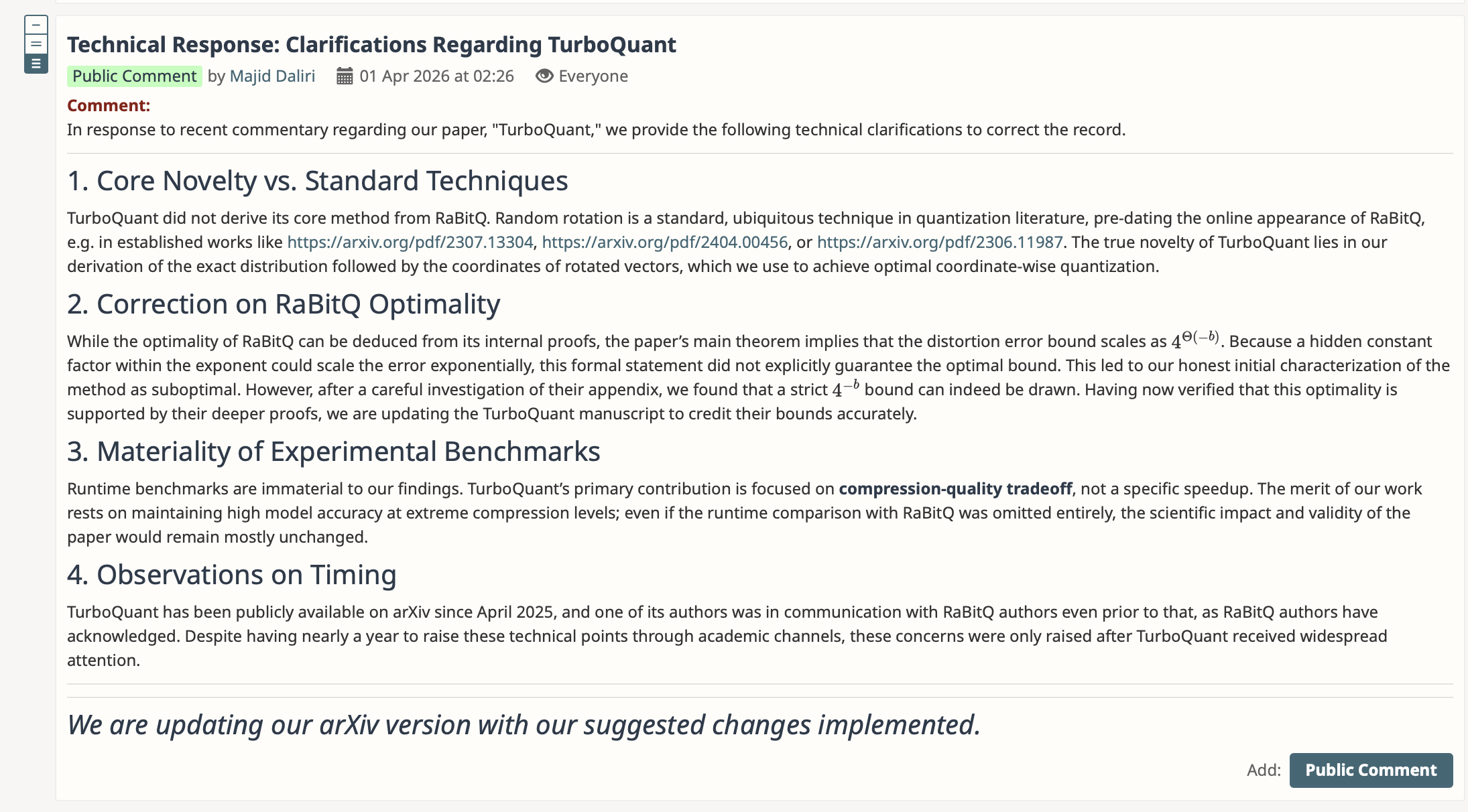

4月1日,面對外界的指控,論文第二作者M(jìn)ajid Daliri終于出來,代表團(tuán)隊在OpenReview平臺上發(fā)布了一份共四個點的“技術(shù)澄清”。

在核心技術(shù)新穎性方面,谷歌辯稱,TurboQuant的核心方法并非源自RaBitQ。因為“隨機(jī)旋轉(zhuǎn)是量化文獻(xiàn)中一種標(biāo)準(zhǔn)的、無處不在的技術(shù)”,早在RaBitQ出現(xiàn)前就被廣泛使用。TurboQuant的真正創(chuàng)新在于推導(dǎo)出了旋轉(zhuǎn)后的坐標(biāo)分布。

但學(xué)術(shù)圈的規(guī)則是:如果某人是第一個把“輪子”用在“汽車”上,并造出了完整的車,后來的造車者引用并致謝是基本的學(xué)術(shù)禮儀。谷歌將前人成果輕描淡寫為行業(yè)常識,等于把先行者貢獻(xiàn)降級了。

其次,關(guān)于貶低RaBitQ理論為“次優(yōu)”的指控,論文作者承認(rèn),是因為自己沒仔細(xì)看對方的附錄,漏了一個常數(shù)因子,才得出了草率的結(jié)論,“導(dǎo)致我們最初誠實地將該方法描述為次優(yōu)”。現(xiàn)在仔細(xì)研究了,發(fā)現(xiàn)RaBitQ確實是最優(yōu)的,團(tuán)隊正在更新TurboQuant手稿。

不過,一篇頂會論文,對同行核心理論的負(fù)面評價建立在“沒看清附錄”的基礎(chǔ)上,這一解釋的力度難免受到質(zhì)疑。

在第三點,針對“把對手綁住手腳再賽跑”的指控,Majid Daliri直接指出,即使完全省略了與RaBitQ的運(yùn)行時比較,該論文的科學(xué)影響和有效性也基本保持不變。因為TurboQuant的主要貢獻(xiàn)在于壓縮質(zhì)量的權(quán)衡,而不是特定的加速。

此前高健揚(yáng)在公開信中披露,谷歌團(tuán)隊測試RaBitQ時使用單核CPU并關(guān)閉多線程,測試TurboQuant時則采用英偉達(dá)A100 GPU。盡管團(tuán)隊宣稱速度對比并非核心,論文中卻仍將速度作為關(guān)鍵賣點之一。

最后,谷歌在回應(yīng)中暗示對方“別有用心”,指出論文自2025年4月就在arXiv發(fā)布,對方有將近一年時間通過學(xué)術(shù)渠道提問題,卻等到論文獲得廣泛關(guān)注后才鬧大。

根據(jù)高健揚(yáng)此前的回應(yīng),早在2025年5月雙方就通過郵件私下溝通,2025年11月還曾聯(lián)系ICLR組委會,但均未得到有效回應(yīng)。直到谷歌通過官方渠道將論文推上千萬級曝光量的神壇,學(xué)術(shù)糾正才變得迫在眉睫。

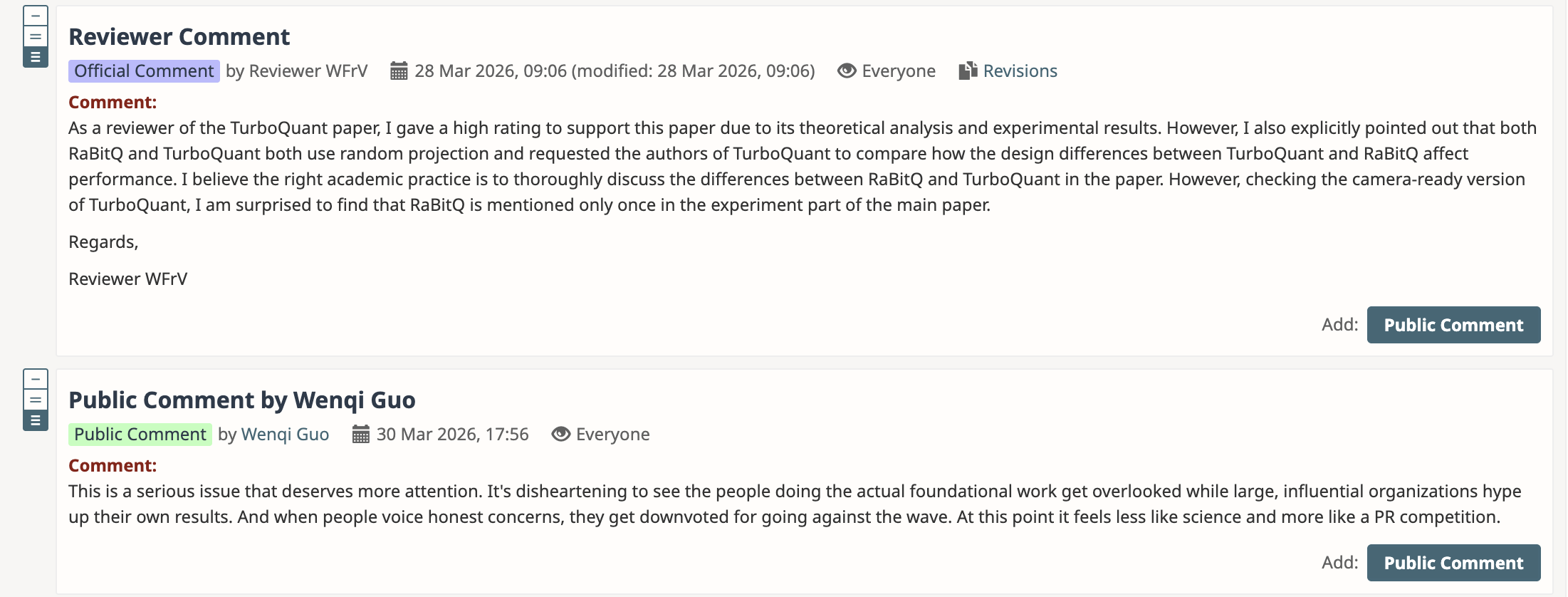

在OpenReview上,有研究者評論,這是一個值得更多關(guān)注的嚴(yán)重問題。“看到從事實際基礎(chǔ)工作的人被忽視,而大型、有影響力的組織卻大肆宣傳自己的成果,這令人沮喪。”在這一點上,感覺不像是科學(xué),更像是一場與大廠的公關(guān)競賽。

同時,TurboQuant論文的審稿人也站出來表達(dá)態(tài)度,稱由于其理論分析和實驗結(jié)果,對這篇論文曾給予了很高的評價。

“然而我也明確指出,RaBitQ和TurboQuant都使用隨機(jī)旋轉(zhuǎn),并要求TurboQuant的作者比較TurboQuant和RaBitQ之間的設(shè)計差異如何影響性能。”這位審稿人表示,正確的學(xué)術(shù)實踐是在論文中深入討論RaBitQ和TurboQuant之間的差異,但審稿時“驚訝地發(fā)現(xiàn)RaBitQ在主論文的實驗部分只提到過一次”。

不可否認(rèn),TurboQuant在技術(shù)層面具備商業(yè)潛力。一位人工智能碩士在知乎上分析稱,在大模型推理場景中,KV緩存內(nèi)存占用直接決定單卡可同時處理的請求數(shù)量,是推理服務(wù)商最核心的經(jīng)濟(jì)指標(biāo)。同樣一張卡,并發(fā)量若提升6倍,每個請求的推理成本理論上可降至原來的六分之一。對于那些每天處理數(shù)十億次API調(diào)用的AI廠商而言,這將是一項巨大的降本利器,這也是此次股市震蕩的原因。

谷歌這一論文即將在4月底的機(jī)器學(xué)習(xí)頂級會議ICLR 2026上發(fā)表,但看起來團(tuán)隊要先邁過這場學(xué)術(shù)爭議的門檻。風(fēng)波最終會如何收場,仍有待觀察。